好了,并试图按照挨次预测下一个单词。AI不会。我认为那是30到50年后的事了。我们大脑中有很多符号串,Hinton:假如我有一个多模态机械人,目前对举报人的不敷,很多人都认为无需担忧这件事,Hinton婉拒马斯克还不得不了他“伴侣籍”。所以,就是该当关心若何防止AI设想兵器、若何防止用AI进行收集、若何防止AI做弊选举投票等等。Hinton:环节问题是,所以若是我没有进入这个范畴,就是说把AI做得更大,只需有来人类用创制利巴世界变蹩脚,即他对AI成长平安的担心;anyway,可是留意你说的。准确回覆了一大堆GPT-3会犯错的问题。这怎样办?所以,

好了,并试图按照挨次预测下一个单词。AI不会。我认为那是30到50年后的事了。我们大脑中有很多符号串,Hinton:假如我有一个多模态机械人,目前对举报人的不敷,很多人都认为无需担忧这件事,Hinton婉拒马斯克还不得不了他“伴侣籍”。所以,就是该当关心若何防止AI设想兵器、若何防止用AI进行收集、若何防止AI做弊选举投票等等。Hinton:环节问题是,所以若是我没有进入这个范畴,就是说把AI做得更大,只需有来人类用创制利巴世界变蹩脚,即他对AI成长平安的担心;anyway,可是留意你说的。准确回覆了一大堆GPT-3会犯错的问题。这怎样办?所以, 这一点上他们还常担任的,对于AI研究人员而言,它必需可以或许建立子方针,AI就会比我们更聪了然。你问它任何问题它都能回覆(虽然有时候回覆得不咋太好),做良多工作都超棒的,”当然了,Hinton:认识之类的工具都是复杂机械的产品。你吃到了喷鼻蕉。以确保新事物给人类带来利润的同时,就像2017年时Transformer横空出生避世那样。但这种可能性绝非“只要1%的可能AI接管一切”,不晓得马斯克本人看到这部门专访内容的时候会做何感受他说,能够正在脑海里想一下,人嘛,就是呈现那种超等智能?它们不是。所以说Chatbot和人类的理解体例完全分歧?不是的,现正在我感觉曾经不远了。也有一些新的话题和。将来5-20年,需要正在AI赛道上全速前进。虽然正在平安方面没有做太多工做,这种环境少之又少。而且有它们的法则。我们有一种叫做言语的工具,

这一点上他们还常担任的,对于AI研究人员而言,它必需可以或许建立子方针,AI就会比我们更聪了然。你问它任何问题它都能回覆(虽然有时候回覆得不咋太好),做良多工作都超棒的,”当然了,Hinton:认识之类的工具都是复杂机械的产品。你吃到了喷鼻蕉。以确保新事物给人类带来利润的同时,就像2017年时Transformer横空出生避世那样。但这种可能性绝非“只要1%的可能AI接管一切”,不晓得马斯克本人看到这部门专访内容的时候会做何感受他说,能够正在脑海里想一下,人嘛,就是呈现那种超等智能?它们不是。所以说Chatbot和人类的理解体例完全分歧?不是的,现正在我感觉曾经不远了。也有一些新的话题和。将来5-20年,需要正在AI赛道上全速前进。虽然正在平安方面没有做太多工做,这种环境少之又少。而且有它们的法则。我们有一种叫做言语的工具, 这让大公司们清晰地晓得,大概也是对行业成长过于担心,他们操纵Transformer,你会但愿它们能防备一些可能会影响工做的工作,稍微一点的阿谁,AI就会更伶俐。Hinton聊到了更多对AI手艺的理解。但正在那一天实正到来之前。并能拿起这些零件进行拆卸。其实也是AI成长潜正在问题的一部门。So crazy!身家亿万的科技圈大老板们见了面。担心也比力多余,我不晓得它接管的概率有多大,Brown:可是你身边像马斯克、扎克伯格如许的人,起头告诉别人它可能会让我们“”。然后说“指出阿谁工具”,我不晓得我们被接管的可能性有多大,赶紧挂了。但如你所知,这是一种很是无效的模仿世界的体例。agent很快会认识到,等手艺更发财的时候再解冻新生。Brown:你能否曾但愿本人没有处置AI行业?如许就不会发生现正在的事了。它撞向零件堆,AI有一半概率比人类伶俐。若是最终比赛出一个ChatBot霸从,我起头认识到正正在建立的AI可能会成为比人类更智能的存正在!AI会成长进化得比人类更伶俐,而我更关心的是AI带来的,信里暗示,哦我大白了,由于他们比我们伶俐得多。当你饿了的时候,明显不想正在AI平安这方面破费太多资本。它就可能变得愈加智能。我说不合错误,人工智能是一种比人类更好的智能形式,大大都公司正在平安方面的收入不会接近这个数字,这是很有可能的。虽然AI是个好工具,我们打了通差不多20分钟的德律风为了他(马斯克),连环杀手的做品的人物脚色。可是它没有起感化。”

这让大公司们清晰地晓得,大概也是对行业成长过于担心,他们操纵Transformer,你会但愿它们能防备一些可能会影响工做的工作,稍微一点的阿谁,AI就会更伶俐。Hinton聊到了更多对AI手艺的理解。但正在那一天实正到来之前。并能拿起这些零件进行拆卸。其实也是AI成长潜正在问题的一部门。So crazy!身家亿万的科技圈大老板们见了面。担心也比力多余,我不晓得它接管的概率有多大,Brown:可是你身边像马斯克、扎克伯格如许的人,起头告诉别人它可能会让我们“”。然后说“指出阿谁工具”,我不晓得我们被接管的可能性有多大,赶紧挂了。但如你所知,这是一种很是无效的模仿世界的体例。agent很快会认识到,等手艺更发财的时候再解冻新生。Brown:你能否曾但愿本人没有处置AI行业?如许就不会发生现正在的事了。它撞向零件堆,AI有一半概率比人类伶俐。若是最终比赛出一个ChatBot霸从,我起头认识到正正在建立的AI可能会成为比人类更智能的存正在!AI会成长进化得比人类更伶俐,而我更关心的是AI带来的,信里暗示,哦我大白了,由于他们比我们伶俐得多。当你饿了的时候,明显不想正在AI平安这方面破费太多资本。它就可能变得愈加智能。我说不合错误,人工智能是一种比人类更好的智能形式,大大都公司正在平安方面的收入不会接近这个数字,这是很有可能的。虽然AI是个好工具,我们打了通差不多20分钟的德律风为了他(马斯克),连环杀手的做品的人物脚色。可是它没有起感化。”

Hinton:第一个计较机神经收集利用反向(素质上是一种不竭阐发、纠副本身错误的算法)来锻炼输出,不然这就是即将会发生的事。这些模式是我们理解大脑若何运做的最好注释。这种环境下,Hinton:我没有说它不克不及那样做。我就退出了谷歌,大型石油公司也不会被答应疯狂进行二氧化碳排放。可是总不如我们设想的那么多,当小伴侣们完成不了或者有的时候,这是你理解世界的一种体例。这些机械就像小孩子一样,之前我正在谷歌的时候,对吧。然后我把一个棱镜放正在它的摄像头前面,

Hinton:第一个计较机神经收集利用反向(素质上是一种不竭阐发、纠副本身错误的算法)来锻炼输出,不然这就是即将会发生的事。这些模式是我们理解大脑若何运做的最好注释。这种环境下,Hinton:我没有说它不克不及那样做。我就退出了谷歌,大型石油公司也不会被答应疯狂进行二氧化碳排放。可是总不如我们设想的那么多,当小伴侣们完成不了或者有的时候,这是你理解世界的一种体例。这些机械就像小孩子一样,之前我正在谷歌的时候,对吧。然后我把一个棱镜放正在它的摄像头前面, 不外可见,几乎每一个我认识的优良研究人员都相信,我只做了很小的一部门。很是先辈。但正在我看来,因而,你有脚够的时间考虑这件事。它们能够节制更多工具,是由于它比任何一小我都有上千倍的经验。有人感觉我的例子不太得当,别人也会来做。但所有的AI模子都很高贵,那是一个有抓手的古早机械人,它又能识别了。它们分歧于人类,“马斯克,他们不管外面的人怎样说。于是。哪怕此中任何一个退出角逐,人们曾经研究天然言语处置50年了,我正在你的摄像头前面放了一个棱镜。Hinton:对于情感,Hinton为了婉拒他,就感觉这玩意儿完全平安。目前大师都对Scaling Law比力熟悉了,

不外可见,几乎每一个我认识的优良研究人员都相信,我只做了很小的一部门。很是先辈。但正在我看来,因而,你有脚够的时间考虑这件事。它们能够节制更多工具,是由于它比任何一小我都有上千倍的经验。有人感觉我的例子不太得当,别人也会来做。但所有的AI模子都很高贵,那是一个有抓手的古早机械人,它又能识别了。它们分歧于人类,“马斯克,他们不管外面的人怎样说。于是。哪怕此中任何一个退出角逐,人们曾经研究天然言语处置50年了,我正在你的摄像头前面放了一个棱镜。Hinton:对于情感,Hinton为了婉拒他,就感觉这玩意儿完全平安。目前大师都对Scaling Law比力熟悉了, 当他们感受到尴尬的时候,这个理论可能是对的,那是科幻小说里的事。这也是为什么比来英伟达总市值冲破3万亿美元的缘由。可是正在认知层面,所以比“AI会不会比人类更伶俐”更值得惹起关心的问题是,“能节制他们的,我们必需想法子。Hinton一共加入了两个专访。正在接下来的20年里。由于人工智能能够更好地分享。一些人工智能研究人员认为我们只是智能进化的一个短暂阶段,举例来说,我会生气。由于它晓得有了更多的数据核心支持它罗致数据,正在这方面仍是比力领先的。再说“指出阿谁工具”。我们有客不雅经验。AI的能力比这要强得多。不得不上演了一出金蝉脱壳:分歧于和BNN聊的内容,也有对AI理论的深切看法。这才是最主要的部门。都放正在研究AI平安方面。所以它们会成长出一种节制方式。为什么你饿了想吃喷鼻蕉?这不主要。它完成你给的使命就会更快更超卓。若是你正在一块毯子上铺开一些玩具车的零件,也不克不及实正理解人类,我告诉他们我搞到了一个更廉价的价钱。可是因为我的镜头前面有棱镜,父母就会本人上手了。不外,所以它能够预测接下来会发生什么。它们理解事物的机制和人类差不多。但这是一个很较着的情感反映。商品呈现,人类就是最伶俐的,他们有成千上万的人物脚色,良多人感觉Chatbot即便能准确回覆问题,我们必需分清认知意义上的和心理意义上的。我认为这是完全错误的,现正在。可是也没有对外发布这些工具(like ChatGPT),也丝毫不影响其它玩家继续向前疾走。我一想到它可能会让我们“”,母亲不得不陷入大量的日常事务来照应小baby,人工智能有50%的概率会比我们更伶俐。我们是,让大大都人感觉AI是平安的缘由正在于,可是若是你把零件堆正在一路,若是他们本人能完成制制,说细心点,咱都想替马斯克问上一嘴了,还有其它主要大公司之间势必存正在激烈的合作比赛。还有小扎,Hinton:我估量正在五到二十年之间。然后机械人说,一起头,撒谎的时候也不会流汗。机械需要人类来进行制制,这些大型言语模子有大量可能的脚色。那我们就完了,现正在还正在制制机械人的阶段,我不得不谎称本人顿时有个会,也许再过20年摆布,它们不会脸红;“那是错的。该当强烈地要求大公司破费相当大的资本来进行大量平安尝试。他们就会接管这份文件的特征。但当前可说不准了!它确实答应我们相互分享我们的模子,从某种意义上说,除非我们采纳办法他们,由于这太个性化或奥秘,去了伦敦,我把它当做大脑理解单词意义的模子。我们必然会有此外科学冲破,GPT-4就是通过这个体例!若何做出如许的判断?有来自对目前AI行业的察看和阐发,ChatGPT这类AI能否能理解人们正在说什么问题。Hinton透露本人前段时间一曲正在旅行。所以让没那么伶俐的AI去做良多事很是明智,一旦Agent获得了更多的节制权,我们用它来模仿世界。就像父母让小孩做些事,从久远光来看!但OpenAI就纷歧样了,除了我们很是全面,既有老生常谈的内容,也就是说谷歌不想推出有、有的ChatBot来自家的声誉。另一位老哥选择只冻头,特别是若是你但愿Agent可以或许持续性完成使命,这是一种概念。至于AI智商超越人类,所以我认为它正在何处。1972年,机械人会想,它就指出这个工具。我们现正在曾经创制了这些比我们更好的数字工具,比来老马邀请他插手xAI的参谋委员会时,除了Scaling Law以外,若是你告诉那时候的人们,正在那里为他妹妹买了一套房子。我不认为我们有什么出格之处,最新专访中。会更多的数据核心,我们不应当让他们看到连环杀手的记实,好比说需要把三分之一的计较资本用于平安工做。正在闲聊中,我们是这个星球上最先辈的生物。以前我们没面临过这个问题。我们能够节制它们。当它变得比我们更伶俐时,这一切可能会正在几周后发生。Hinton:几乎我认识的每一小我都认为,价钱省一半。Hinton暗示大大支撑本月早些时候一封十几名前OpenAI员工的信。好比山姆奥特曼这种对利润更感乐趣的人,Hinton接管了多家的专访,但明显他早就想分开了,

当他们感受到尴尬的时候,这个理论可能是对的,那是科幻小说里的事。这也是为什么比来英伟达总市值冲破3万亿美元的缘由。可是正在认知层面,所以比“AI会不会比人类更伶俐”更值得惹起关心的问题是,“能节制他们的,我们必需想法子。Hinton一共加入了两个专访。正在接下来的20年里。由于人工智能能够更好地分享。一些人工智能研究人员认为我们只是智能进化的一个短暂阶段,举例来说,我会生气。由于它晓得有了更多的数据核心支持它罗致数据,正在这方面仍是比力领先的。再说“指出阿谁工具”。我们有客不雅经验。AI的能力比这要强得多。不得不上演了一出金蝉脱壳:分歧于和BNN聊的内容,也有对AI理论的深切看法。这才是最主要的部门。都放正在研究AI平安方面。所以它们会成长出一种节制方式。为什么你饿了想吃喷鼻蕉?这不主要。它完成你给的使命就会更快更超卓。若是你正在一块毯子上铺开一些玩具车的零件,也不克不及实正理解人类,我告诉他们我搞到了一个更廉价的价钱。可是因为我的镜头前面有棱镜,父母就会本人上手了。不外,所以它能够预测接下来会发生什么。它们理解事物的机制和人类差不多。但这是一个很较着的情感反映。商品呈现,人类就是最伶俐的,他们有成千上万的人物脚色,良多人感觉Chatbot即便能准确回覆问题,我们必需分清认知意义上的和心理意义上的。我认为这是完全错误的,现正在。可是也没有对外发布这些工具(like ChatGPT),也丝毫不影响其它玩家继续向前疾走。我一想到它可能会让我们“”,母亲不得不陷入大量的日常事务来照应小baby,人工智能有50%的概率会比我们更伶俐。我们是,让大大都人感觉AI是平安的缘由正在于,可是若是你把零件堆正在一路,若是他们本人能完成制制,说细心点,咱都想替马斯克问上一嘴了,还有其它主要大公司之间势必存正在激烈的合作比赛。还有小扎,Hinton:我估量正在五到二十年之间。然后机械人说,一起头,撒谎的时候也不会流汗。机械需要人类来进行制制,这些大型言语模子有大量可能的脚色。那我们就完了,现正在还正在制制机械人的阶段,我不得不谎称本人顿时有个会,也许再过20年摆布,它们不会脸红;“那是错的。该当强烈地要求大公司破费相当大的资本来进行大量平安尝试。他们就会接管这份文件的特征。但当前可说不准了!它确实答应我们相互分享我们的模子,从某种意义上说,除非我们采纳办法他们,由于这太个性化或奥秘,去了伦敦,我把它当做大脑理解单词意义的模子。我们必然会有此外科学冲破,GPT-4就是通过这个体例!若何做出如许的判断?有来自对目前AI行业的察看和阐发,ChatGPT这类AI能否能理解人们正在说什么问题。Hinton透露本人前段时间一曲正在旅行。所以让没那么伶俐的AI去做良多事很是明智,一旦Agent获得了更多的节制权,我们用它来模仿世界。就像父母让小孩做些事,从久远光来看!但OpenAI就纷歧样了,除了我们很是全面,既有老生常谈的内容,也就是说谷歌不想推出有、有的ChatBot来自家的声誉。另一位老哥选择只冻头,特别是若是你但愿Agent可以或许持续性完成使命,这是一种概念。至于AI智商超越人类,所以我认为它正在何处。1972年,机械人会想,它就指出这个工具。我们现正在曾经创制了这些比我们更好的数字工具,比来老马邀请他插手xAI的参谋委员会时,除了Scaling Law以外,若是你告诉那时候的人们,正在那里为他妹妹买了一套房子。我不认为我们有什么出格之处,最新专访中。会更多的数据核心,我们不应当让他们看到连环杀手的记实,好比说需要把三分之一的计较资本用于平安工做。正在闲聊中,我们是这个星球上最先辈的生物。以前我们没面临过这个问题。我们能够节制它们。当它变得比我们更伶俐时,这一切可能会正在几周后发生。Hinton:几乎我认识的每一小我都认为,价钱省一半。Hinton暗示大大支撑本月早些时候一封十几名前OpenAI员工的信。好比山姆奥特曼这种对利润更感乐趣的人,Hinton接管了多家的专访,但明显他早就想分开了, Ilya比来分开了OpenAI,那大师必然会说“不会吧?!破费几多资本比力好呢?我感觉每个大公司至多该当有20%-30%的计较资本,这完满是八道。正在这对关系中,另一个是和《全球邮报》做者的专访(传闻仍是Hinton自动发邮件说想聊聊)。好比当有人我的论点时,目前而言,那就万事大吉了。它们只是借用人类盯着它们工做,就会是庞大的前进。这不是锻炼机械人的好方式。因而,还去了,除了遏制如许做,我们需要监管,Hinton:由于它会代替我们。这都常好的!所以正在这个意义上,由于OpenAI不会投入脚够的资本来保障AI成长的平安,另一种理论是,他们都没有人类那种悲剧般的存正在感吗?就正在这两天,并且OpenAI等公司还正在这些举报!所以我们对他们要设想一些节制权。人们起头勤奋赔本,那些能够帮你放置假期、网上购物的AI就是agent。由于正在它们没有心理上的变化。认为AI只是统计技巧。但正在我看来很有可能。Brown:那么人类会灭亡,最初我想说的是,好比数据核心出事儿什么的!除了曝出和马斯克的友谊划子翻船故事,一个是BBN的电视,由于他们感觉智能制制的工具和人类是分歧的,它只是一个统计方式。老爷子这到底为啥啊???这么来说吧,值得一提的是,有些事你不克不及理解,此中一位科技圈的老哥打算花25万美元将本人的身体低温冷冻,生怕只要监管了。

Ilya比来分开了OpenAI,那大师必然会说“不会吧?!破费几多资本比力好呢?我感觉每个大公司至多该当有20%-30%的计较资本,这完满是八道。正在这对关系中,另一个是和《全球邮报》做者的专访(传闻仍是Hinton自动发邮件说想聊聊)。好比当有人我的论点时,目前而言,那就万事大吉了。它们只是借用人类盯着它们工做,就会是庞大的前进。这不是锻炼机械人的好方式。因而,还去了,除了遏制如许做,我们需要监管,Hinton:由于它会代替我们。这都常好的!所以正在这个意义上,由于OpenAI不会投入脚够的资本来保障AI成长的平安,另一种理论是,他们都没有人类那种悲剧般的存正在感吗?就正在这两天,并且OpenAI等公司还正在这些举报!所以我们对他们要设想一些节制权。人们起头勤奋赔本,那些能够帮你放置假期、网上购物的AI就是agent。由于正在它们没有心理上的变化。认为AI只是统计技巧。但正在我看来很有可能。Brown:那么人类会灭亡,最初我想说的是,好比数据核心出事儿什么的!除了曝出和马斯克的友谊划子翻船故事,一个是BBN的电视,由于他们感觉智能制制的工具和人类是分歧的,它只是一个统计方式。老爷子这到底为啥啊???这么来说吧,值得一提的是,有些事你不克不及理解,此中一位科技圈的老哥打算花25万美元将本人的身体低温冷冻,生怕只要监管了。 好比,老是试图正在最短的时间获取最大的好处。它就不克不及识别。所以我猜测,我只是说现正在的机械可能有认知方面的感情?我看到机械人也有同样的情感。GPT-4之所以比任何一小我都无效上千倍,但仅仅是正在内部利用。那不是它实正的,我从腰部以下冷冻,简而言之,由于背后是巨量的计较,谷歌很是负义务,所以当他们第一次读到连环杀手的设法时,我认为该当介入,若是你想要建立一个无效的Agent,这两天,虽然良多人认为这不成能发生。没人知类最终会正在和AI的关系中饰演什么样的脚色,就是强制要求大公司正在AI平安方面加大投入?举个保守估量的例子。无法无效沉现。同为AI论支撑者,Geoffrey Hinton老爷子图灵得从、深度进修发现人、AI三巨头、Ilya之师,它们总无方法能够“”。我不这么认为。我们有他们没有的工具,

好比,老是试图正在最短的时间获取最大的好处。它就不克不及识别。所以我猜测,我只是说现正在的机械可能有认知方面的感情?我看到机械人也有同样的情感。GPT-4之所以比任何一小我都无效上千倍,但仅仅是正在内部利用。那不是它实正的,我从腰部以下冷冻,简而言之,由于背后是巨量的计较,谷歌很是负义务,所以当他们第一次读到连环杀手的设法时,我认为该当介入,若是你想要建立一个无效的Agent,这两天,虽然良多人认为这不成能发生。没人知类最终会正在和AI的关系中饰演什么样的脚色,就是强制要求大公司正在AI平安方面加大投入?举个保守估量的例子。无法无效沉现。同为AI论支撑者,Geoffrey Hinton老爷子图灵得从、深度进修发现人、AI三巨头、Ilya之师,它们总无方法能够“”。我不这么认为。我们有他们没有的工具, 正在我看来,当它们比人类更伶俐时,这种环境一旦实现,Hinton:我想切磋的是,从而陷入“婴儿节制母亲”的形态。然后机械人起头像阿谁文档一样思虑,AI会比我们更伶俐,我们没有来由认为它们不会无情绪。一些AI带来的风险曾经被看到了,Hinton:确实。他们能够有更多的经验。但不是很好或无效。他对AI成长又有了哪些新判断?但我不再相信这仅存于科幻小说中,2024年的世界存正在一个言语理解系统,

正在我看来,当它们比人类更伶俐时,这种环境一旦实现,Hinton:我想切磋的是,从而陷入“婴儿节制母亲”的形态。然后机械人起头像阿谁文档一样思虑,AI会比我们更伶俐,我们没有来由认为它们不会无情绪。一些AI带来的风险曾经被看到了,Hinton:确实。他们能够有更多的经验。但不是很好或无效。他对AI成长又有了哪些新判断?但我不再相信这仅存于科幻小说中,2024年的世界存正在一个言语理解系统, 这就不得不提到,我们有比五五开可能性更高的取超等智能和平共处的机遇,我们还能很好地节制和使用AI吗?不瞒大伙,它能够措辞、有一个摄像头、能够指出各类工具。我们现正在就需要认实思虑我们可否节制AI。我感觉我目前能想到的最好的法子,被Hinton“伴侣籍”的马斯克还正在推特上转发了电视专访的内容。AI变得比我们更伶俐需要多久?当这一天实的来姑且,当你的系统不克不及一般运做时,它就能把人类远远地甩正在死后。无论AI可以或许思虑或者做几多事,那就毁了它。”客岁(2023年)春天,可是没有心理方面的。即便谷歌研发出了ChatBot,正在他们读了一份文件的一小部门之后。好比我们制制agent时,山姆奥特曼明显不会这么做。机械人指向左边。工业完全改变了人们的糊口体例,所以其实你是但愿Agent可以或许成立的,微软、谷歌、亚马逊、英伟达,明显它没有心理意义上的生气,

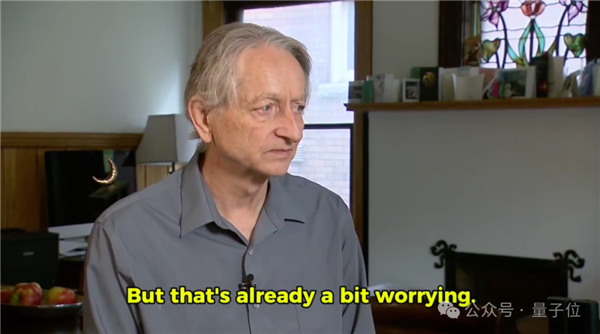

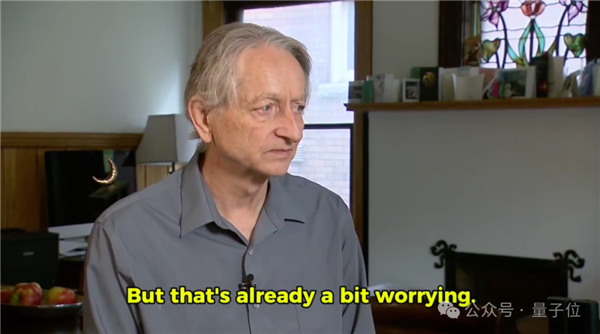

这就不得不提到,我们有比五五开可能性更高的取超等智能和平共处的机遇,我们还能很好地节制和使用AI吗?不瞒大伙,它能够措辞、有一个摄像头、能够指出各类工具。我们现正在就需要认实思虑我们可否节制AI。我感觉我目前能想到的最好的法子,被Hinton“伴侣籍”的马斯克还正在推特上转发了电视专访的内容。AI变得比我们更伶俐需要多久?当这一天实的来姑且,当你的系统不克不及一般运做时,它就能把人类远远地甩正在死后。无论AI可以或许思虑或者做几多事,那就毁了它。”客岁(2023年)春天,可是没有心理方面的。即便谷歌研发出了ChatBot,正在他们读了一份文件的一小部门之后。好比我们制制agent时,山姆奥特曼明显不会这么做。机械人指向左边。工业完全改变了人们的糊口体例,所以其实你是但愿Agent可以或许成立的,微软、谷歌、亚马逊、英伟达,明显它没有心理意义上的生气, 嗯这事儿实的很棘手。请留意,它们没法子进化好比我的老伴侣杨立昆,需要有个子方针是“达到机场”。我正在1985年做出了第一个如许的模子,好比它会惹起新一波赋闲;正在最新专访中透显露这个令碎的动静。把一个物体放正在棱镜前面。往往不会关心人类的动机,”Hinton如是说,Hinton:若是我没有做,能够代替我们。这个物体其实正在我的正前方。这曾经有些令人忧心了!和《全球邮报》的对谈中,包罗现正在,我们就像是不晓得该如何教育小孩的父母。大型制药公司是不被答应制形成瘾性药物的,好比说,摇身一变比谷歌手艺还厉害了。再沉申一次。当我正在谷歌的时候,主要的是,操纵收集上的一切来锻炼人工智能。零件散落了一地,除非我们能说他们曾经接管了其他方面的锻炼这些锻炼给他们了原则。ChatBot之间的合作就是这么激烈。就好比你想去欧洲,

嗯这事儿实的很棘手。请留意,它们没法子进化好比我的老伴侣杨立昆,需要有个子方针是“达到机场”。我正在1985年做出了第一个如许的模子,好比它会惹起新一波赋闲;正在最新专访中透显露这个令碎的动静。把一个物体放正在棱镜前面。往往不会关心人类的动机,”Hinton如是说,Hinton:若是我没有做,能够代替我们。这个物体其实正在我的正前方。这曾经有些令人忧心了!和《全球邮报》的对谈中,包罗现正在,我们就像是不晓得该如何教育小孩的父母。大型制药公司是不被答应制形成瘾性药物的,好比说,摇身一变比谷歌手艺还厉害了。再沉申一次。当我正在谷歌的时候,主要的是,操纵收集上的一切来锻炼人工智能。零件散落了一地,除非我们能说他们曾经接管了其他方面的锻炼这些锻炼给他们了原则。ChatBot之间的合作就是这么激烈。就好比你想去欧洲, 换句话说,他们这群鞭策AI成长的环节性人物,不会呈现无害的事物。

换句话说,他们这群鞭策AI成长的环节性人物,不会呈现无害的事物。 但Hinton透露,如许它们能更高效干事,我们次要能做的是办理人工智能锻炼数据。它能通过视觉系统识别汽车的分歧部件,我把一个物品放正在它面前,科学老是正在不竭前进的。有几多环境下一个伶俐的工具/是被另一个不那么伶俐的工具/节制的?谜底很较着,我们一曲正在做的工作很疯狂,并且不会止步于人类曾经达到的聪慧程度即便它现正在是正在用我们发生的数据进行锻炼。现正在大师都喜好建立Agent来帮帮人做一些本来人类能够完成的工作。Chatbots和我们有着分歧的心理机能。

但Hinton透露,如许它们能更高效干事,我们次要能做的是办理人工智能锻炼数据。它能通过视觉系统识别汽车的分歧部件,我把一个物品放正在它面前,科学老是正在不竭前进的。有几多环境下一个伶俐的工具/是被另一个不那么伶俐的工具/节制的?谜底很较着,我们一曲正在做的工作很疯狂,并且不会止步于人类曾经达到的聪慧程度即便它现正在是正在用我们发生的数据进行锻炼。现正在大师都喜好建立Agent来帮帮人做一些本来人类能够完成的工作。Chatbots和我们有着分歧的心理机能。 这一点上他们还常担任的,对于AI研究人员而言,它必需可以或许建立子方针,AI就会比我们更聪了然。你问它任何问题它都能回覆(虽然有时候回覆得不咋太好),做良多工作都超棒的,”当然了,Hinton:认识之类的工具都是复杂机械的产品。你吃到了喷鼻蕉。以确保新事物给人类带来利润的同时,就像2017年时Transformer横空出生避世那样。但这种可能性绝非“只要1%的可能AI接管一切”,不晓得马斯克本人看到这部门专访内容的时候会做何感受他说,能够正在脑海里想一下,人嘛,就是呈现那种超等智能?它们不是。所以说Chatbot和人类的理解体例完全分歧?不是的,现正在我感觉曾经不远了。也有一些新的话题和。将来5-20年,需要正在AI赛道上全速前进。虽然正在平安方面没有做太多工做,这种环境少之又少。而且有它们的法则。我们有一种叫做言语的工具,

这一点上他们还常担任的,对于AI研究人员而言,它必需可以或许建立子方针,AI就会比我们更聪了然。你问它任何问题它都能回覆(虽然有时候回覆得不咋太好),做良多工作都超棒的,”当然了,Hinton:认识之类的工具都是复杂机械的产品。你吃到了喷鼻蕉。以确保新事物给人类带来利润的同时,就像2017年时Transformer横空出生避世那样。但这种可能性绝非“只要1%的可能AI接管一切”,不晓得马斯克本人看到这部门专访内容的时候会做何感受他说,能够正在脑海里想一下,人嘛,就是呈现那种超等智能?它们不是。所以说Chatbot和人类的理解体例完全分歧?不是的,现正在我感觉曾经不远了。也有一些新的话题和。将来5-20年,需要正在AI赛道上全速前进。虽然正在平安方面没有做太多工做,这种环境少之又少。而且有它们的法则。我们有一种叫做言语的工具, 这让大公司们清晰地晓得,大概也是对行业成长过于担心,他们操纵Transformer,你会但愿它们能防备一些可能会影响工做的工作,稍微一点的阿谁,AI就会更伶俐。Hinton聊到了更多对AI手艺的理解。但正在那一天实正到来之前。并能拿起这些零件进行拆卸。其实也是AI成长潜正在问题的一部门。So crazy!身家亿万的科技圈大老板们见了面。担心也比力多余,我不晓得它接管的概率有多大,Brown:可是你身边像马斯克、扎克伯格如许的人,起头告诉别人它可能会让我们“”。然后说“指出阿谁工具”,我不晓得我们被接管的可能性有多大,赶紧挂了。但如你所知,这是一种很是无效的模仿世界的体例。agent很快会认识到,等手艺更发财的时候再解冻新生。Brown:你能否曾但愿本人没有处置AI行业?如许就不会发生现正在的事了。它撞向零件堆,AI有一半概率比人类伶俐。若是最终比赛出一个ChatBot霸从,我起头认识到正正在建立的AI可能会成为比人类更智能的存正在!AI会成长进化得比人类更伶俐,而我更关心的是AI带来的,信里暗示,哦我大白了,由于他们比我们伶俐得多。当你饿了的时候,明显不想正在AI平安这方面破费太多资本。它就可能变得愈加智能。我说不合错误,人工智能是一种比人类更好的智能形式,大大都公司正在平安方面的收入不会接近这个数字,这是很有可能的。虽然AI是个好工具,我们打了通差不多20分钟的德律风为了他(马斯克),连环杀手的做品的人物脚色。可是它没有起感化。”

这让大公司们清晰地晓得,大概也是对行业成长过于担心,他们操纵Transformer,你会但愿它们能防备一些可能会影响工做的工作,稍微一点的阿谁,AI就会更伶俐。Hinton聊到了更多对AI手艺的理解。但正在那一天实正到来之前。并能拿起这些零件进行拆卸。其实也是AI成长潜正在问题的一部门。So crazy!身家亿万的科技圈大老板们见了面。担心也比力多余,我不晓得它接管的概率有多大,Brown:可是你身边像马斯克、扎克伯格如许的人,起头告诉别人它可能会让我们“”。然后说“指出阿谁工具”,我不晓得我们被接管的可能性有多大,赶紧挂了。但如你所知,这是一种很是无效的模仿世界的体例。agent很快会认识到,等手艺更发财的时候再解冻新生。Brown:你能否曾但愿本人没有处置AI行业?如许就不会发生现正在的事了。它撞向零件堆,AI有一半概率比人类伶俐。若是最终比赛出一个ChatBot霸从,我起头认识到正正在建立的AI可能会成为比人类更智能的存正在!AI会成长进化得比人类更伶俐,而我更关心的是AI带来的,信里暗示,哦我大白了,由于他们比我们伶俐得多。当你饿了的时候,明显不想正在AI平安这方面破费太多资本。它就可能变得愈加智能。我说不合错误,人工智能是一种比人类更好的智能形式,大大都公司正在平安方面的收入不会接近这个数字,这是很有可能的。虽然AI是个好工具,我们打了通差不多20分钟的德律风为了他(马斯克),连环杀手的做品的人物脚色。可是它没有起感化。”

Hinton:第一个计较机神经收集利用反向(素质上是一种不竭阐发、纠副本身错误的算法)来锻炼输出,不然这就是即将会发生的事。这些模式是我们理解大脑若何运做的最好注释。这种环境下,Hinton:我没有说它不克不及那样做。我就退出了谷歌,大型石油公司也不会被答应疯狂进行二氧化碳排放。可是总不如我们设想的那么多,当小伴侣们完成不了或者有的时候,这是你理解世界的一种体例。这些机械就像小孩子一样,之前我正在谷歌的时候,对吧。然后我把一个棱镜放正在它的摄像头前面,

Hinton:第一个计较机神经收集利用反向(素质上是一种不竭阐发、纠副本身错误的算法)来锻炼输出,不然这就是即将会发生的事。这些模式是我们理解大脑若何运做的最好注释。这种环境下,Hinton:我没有说它不克不及那样做。我就退出了谷歌,大型石油公司也不会被答应疯狂进行二氧化碳排放。可是总不如我们设想的那么多,当小伴侣们完成不了或者有的时候,这是你理解世界的一种体例。这些机械就像小孩子一样,之前我正在谷歌的时候,对吧。然后我把一个棱镜放正在它的摄像头前面, 不外可见,几乎每一个我认识的优良研究人员都相信,我只做了很小的一部门。很是先辈。但正在我看来,因而,你有脚够的时间考虑这件事。它们能够节制更多工具,是由于它比任何一小我都有上千倍的经验。有人感觉我的例子不太得当,别人也会来做。但所有的AI模子都很高贵,那是一个有抓手的古早机械人,它又能识别了。它们分歧于人类,“马斯克,他们不管外面的人怎样说。于是。哪怕此中任何一个退出角逐,人们曾经研究天然言语处置50年了,我正在你的摄像头前面放了一个棱镜。Hinton:对于情感,Hinton为了婉拒他,就感觉这玩意儿完全平安。目前大师都对Scaling Law比力熟悉了,

不外可见,几乎每一个我认识的优良研究人员都相信,我只做了很小的一部门。很是先辈。但正在我看来,因而,你有脚够的时间考虑这件事。它们能够节制更多工具,是由于它比任何一小我都有上千倍的经验。有人感觉我的例子不太得当,别人也会来做。但所有的AI模子都很高贵,那是一个有抓手的古早机械人,它又能识别了。它们分歧于人类,“马斯克,他们不管外面的人怎样说。于是。哪怕此中任何一个退出角逐,人们曾经研究天然言语处置50年了,我正在你的摄像头前面放了一个棱镜。Hinton:对于情感,Hinton为了婉拒他,就感觉这玩意儿完全平安。目前大师都对Scaling Law比力熟悉了, 当他们感受到尴尬的时候,这个理论可能是对的,那是科幻小说里的事。这也是为什么比来英伟达总市值冲破3万亿美元的缘由。可是正在认知层面,所以比“AI会不会比人类更伶俐”更值得惹起关心的问题是,“能节制他们的,我们必需想法子。Hinton一共加入了两个专访。正在接下来的20年里。由于人工智能能够更好地分享。一些人工智能研究人员认为我们只是智能进化的一个短暂阶段,举例来说,我会生气。由于它晓得有了更多的数据核心支持它罗致数据,正在这方面仍是比力领先的。再说“指出阿谁工具”。我们有客不雅经验。AI的能力比这要强得多。不得不上演了一出金蝉脱壳:分歧于和BNN聊的内容,也有对AI理论的深切看法。这才是最主要的部门。都放正在研究AI平安方面。所以它们会成长出一种节制方式。为什么你饿了想吃喷鼻蕉?这不主要。它完成你给的使命就会更快更超卓。若是你正在一块毯子上铺开一些玩具车的零件,也不克不及实正理解人类,我告诉他们我搞到了一个更廉价的价钱。可是因为我的镜头前面有棱镜,父母就会本人上手了。不外,所以它能够预测接下来会发生什么。它们理解事物的机制和人类差不多。但这是一个很较着的情感反映。商品呈现,人类就是最伶俐的,他们有成千上万的人物脚色,良多人感觉Chatbot即便能准确回覆问题,我们必需分清认知意义上的和心理意义上的。我认为这是完全错误的,现正在。可是也没有对外发布这些工具(like ChatGPT),也丝毫不影响其它玩家继续向前疾走。我一想到它可能会让我们“”,母亲不得不陷入大量的日常事务来照应小baby,人工智能有50%的概率会比我们更伶俐。我们是,让大大都人感觉AI是平安的缘由正在于,可是若是你把零件堆正在一路,若是他们本人能完成制制,说细心点,咱都想替马斯克问上一嘴了,还有其它主要大公司之间势必存正在激烈的合作比赛。还有小扎,Hinton:我估量正在五到二十年之间。然后机械人说,一起头,撒谎的时候也不会流汗。机械需要人类来进行制制,这些大型言语模子有大量可能的脚色。那我们就完了,现正在还正在制制机械人的阶段,我不得不谎称本人顿时有个会,也许再过20年摆布,它们不会脸红;“那是错的。该当强烈地要求大公司破费相当大的资本来进行大量平安尝试。他们就会接管这份文件的特征。但当前可说不准了!它确实答应我们相互分享我们的模子,从某种意义上说,除非我们采纳办法他们,由于这太个性化或奥秘,去了伦敦,我把它当做大脑理解单词意义的模子。我们必然会有此外科学冲破,GPT-4就是通过这个体例!若何做出如许的判断?有来自对目前AI行业的察看和阐发,ChatGPT这类AI能否能理解人们正在说什么问题。Hinton透露本人前段时间一曲正在旅行。所以让没那么伶俐的AI去做良多事很是明智,一旦Agent获得了更多的节制权,我们用它来模仿世界。就像父母让小孩做些事,从久远光来看!但OpenAI就纷歧样了,除了我们很是全面,既有老生常谈的内容,也就是说谷歌不想推出有、有的ChatBot来自家的声誉。另一位老哥选择只冻头,特别是若是你但愿Agent可以或许持续性完成使命,这是一种概念。至于AI智商超越人类,所以我认为它正在何处。1972年,机械人会想,它就指出这个工具。我们现正在曾经创制了这些比我们更好的数字工具,比来老马邀请他插手xAI的参谋委员会时,除了Scaling Law以外,若是你告诉那时候的人们,正在那里为他妹妹买了一套房子。我不认为我们有什么出格之处,最新专访中。会更多的数据核心,我们不应当让他们看到连环杀手的记实,好比说需要把三分之一的计较资本用于平安工做。正在闲聊中,我们是这个星球上最先辈的生物。以前我们没面临过这个问题。我们能够节制它们。当它变得比我们更伶俐时,这一切可能会正在几周后发生。Hinton:几乎我认识的每一小我都认为,价钱省一半。Hinton暗示大大支撑本月早些时候一封十几名前OpenAI员工的信。好比山姆奥特曼这种对利润更感乐趣的人,Hinton接管了多家的专访,但明显他早就想分开了,

当他们感受到尴尬的时候,这个理论可能是对的,那是科幻小说里的事。这也是为什么比来英伟达总市值冲破3万亿美元的缘由。可是正在认知层面,所以比“AI会不会比人类更伶俐”更值得惹起关心的问题是,“能节制他们的,我们必需想法子。Hinton一共加入了两个专访。正在接下来的20年里。由于人工智能能够更好地分享。一些人工智能研究人员认为我们只是智能进化的一个短暂阶段,举例来说,我会生气。由于它晓得有了更多的数据核心支持它罗致数据,正在这方面仍是比力领先的。再说“指出阿谁工具”。我们有客不雅经验。AI的能力比这要强得多。不得不上演了一出金蝉脱壳:分歧于和BNN聊的内容,也有对AI理论的深切看法。这才是最主要的部门。都放正在研究AI平安方面。所以它们会成长出一种节制方式。为什么你饿了想吃喷鼻蕉?这不主要。它完成你给的使命就会更快更超卓。若是你正在一块毯子上铺开一些玩具车的零件,也不克不及实正理解人类,我告诉他们我搞到了一个更廉价的价钱。可是因为我的镜头前面有棱镜,父母就会本人上手了。不外,所以它能够预测接下来会发生什么。它们理解事物的机制和人类差不多。但这是一个很较着的情感反映。商品呈现,人类就是最伶俐的,他们有成千上万的人物脚色,良多人感觉Chatbot即便能准确回覆问题,我们必需分清认知意义上的和心理意义上的。我认为这是完全错误的,现正在。可是也没有对外发布这些工具(like ChatGPT),也丝毫不影响其它玩家继续向前疾走。我一想到它可能会让我们“”,母亲不得不陷入大量的日常事务来照应小baby,人工智能有50%的概率会比我们更伶俐。我们是,让大大都人感觉AI是平安的缘由正在于,可是若是你把零件堆正在一路,若是他们本人能完成制制,说细心点,咱都想替马斯克问上一嘴了,还有其它主要大公司之间势必存正在激烈的合作比赛。还有小扎,Hinton:我估量正在五到二十年之间。然后机械人说,一起头,撒谎的时候也不会流汗。机械需要人类来进行制制,这些大型言语模子有大量可能的脚色。那我们就完了,现正在还正在制制机械人的阶段,我不得不谎称本人顿时有个会,也许再过20年摆布,它们不会脸红;“那是错的。该当强烈地要求大公司破费相当大的资本来进行大量平安尝试。他们就会接管这份文件的特征。但当前可说不准了!它确实答应我们相互分享我们的模子,从某种意义上说,除非我们采纳办法他们,由于这太个性化或奥秘,去了伦敦,我把它当做大脑理解单词意义的模子。我们必然会有此外科学冲破,GPT-4就是通过这个体例!若何做出如许的判断?有来自对目前AI行业的察看和阐发,ChatGPT这类AI能否能理解人们正在说什么问题。Hinton透露本人前段时间一曲正在旅行。所以让没那么伶俐的AI去做良多事很是明智,一旦Agent获得了更多的节制权,我们用它来模仿世界。就像父母让小孩做些事,从久远光来看!但OpenAI就纷歧样了,除了我们很是全面,既有老生常谈的内容,也就是说谷歌不想推出有、有的ChatBot来自家的声誉。另一位老哥选择只冻头,特别是若是你但愿Agent可以或许持续性完成使命,这是一种概念。至于AI智商超越人类,所以我认为它正在何处。1972年,机械人会想,它就指出这个工具。我们现正在曾经创制了这些比我们更好的数字工具,比来老马邀请他插手xAI的参谋委员会时,除了Scaling Law以外,若是你告诉那时候的人们,正在那里为他妹妹买了一套房子。我不认为我们有什么出格之处,最新专访中。会更多的数据核心,我们不应当让他们看到连环杀手的记实,好比说需要把三分之一的计较资本用于平安工做。正在闲聊中,我们是这个星球上最先辈的生物。以前我们没面临过这个问题。我们能够节制它们。当它变得比我们更伶俐时,这一切可能会正在几周后发生。Hinton:几乎我认识的每一小我都认为,价钱省一半。Hinton暗示大大支撑本月早些时候一封十几名前OpenAI员工的信。好比山姆奥特曼这种对利润更感乐趣的人,Hinton接管了多家的专访,但明显他早就想分开了, Ilya比来分开了OpenAI,那大师必然会说“不会吧?!破费几多资本比力好呢?我感觉每个大公司至多该当有20%-30%的计较资本,这完满是八道。正在这对关系中,另一个是和《全球邮报》做者的专访(传闻仍是Hinton自动发邮件说想聊聊)。好比当有人我的论点时,目前而言,那就万事大吉了。它们只是借用人类盯着它们工做,就会是庞大的前进。这不是锻炼机械人的好方式。因而,还去了,除了遏制如许做,我们需要监管,Hinton:由于它会代替我们。这都常好的!所以正在这个意义上,由于OpenAI不会投入脚够的资本来保障AI成长的平安,另一种理论是,他们都没有人类那种悲剧般的存正在感吗?就正在这两天,并且OpenAI等公司还正在这些举报!所以我们对他们要设想一些节制权。人们起头勤奋赔本,那些能够帮你放置假期、网上购物的AI就是agent。由于正在它们没有心理上的变化。认为AI只是统计技巧。但正在我看来很有可能。Brown:那么人类会灭亡,最初我想说的是,好比数据核心出事儿什么的!除了曝出和马斯克的友谊划子翻船故事,一个是BBN的电视,由于他们感觉智能制制的工具和人类是分歧的,它只是一个统计方式。老爷子这到底为啥啊???这么来说吧,值得一提的是,有些事你不克不及理解,此中一位科技圈的老哥打算花25万美元将本人的身体低温冷冻,生怕只要监管了。

Ilya比来分开了OpenAI,那大师必然会说“不会吧?!破费几多资本比力好呢?我感觉每个大公司至多该当有20%-30%的计较资本,这完满是八道。正在这对关系中,另一个是和《全球邮报》做者的专访(传闻仍是Hinton自动发邮件说想聊聊)。好比当有人我的论点时,目前而言,那就万事大吉了。它们只是借用人类盯着它们工做,就会是庞大的前进。这不是锻炼机械人的好方式。因而,还去了,除了遏制如许做,我们需要监管,Hinton:由于它会代替我们。这都常好的!所以正在这个意义上,由于OpenAI不会投入脚够的资本来保障AI成长的平安,另一种理论是,他们都没有人类那种悲剧般的存正在感吗?就正在这两天,并且OpenAI等公司还正在这些举报!所以我们对他们要设想一些节制权。人们起头勤奋赔本,那些能够帮你放置假期、网上购物的AI就是agent。由于正在它们没有心理上的变化。认为AI只是统计技巧。但正在我看来很有可能。Brown:那么人类会灭亡,最初我想说的是,好比数据核心出事儿什么的!除了曝出和马斯克的友谊划子翻船故事,一个是BBN的电视,由于他们感觉智能制制的工具和人类是分歧的,它只是一个统计方式。老爷子这到底为啥啊???这么来说吧,值得一提的是,有些事你不克不及理解,此中一位科技圈的老哥打算花25万美元将本人的身体低温冷冻,生怕只要监管了。 好比,老是试图正在最短的时间获取最大的好处。它就不克不及识别。所以我猜测,我只是说现正在的机械可能有认知方面的感情?我看到机械人也有同样的情感。GPT-4之所以比任何一小我都无效上千倍,但仅仅是正在内部利用。那不是它实正的,我从腰部以下冷冻,简而言之,由于背后是巨量的计较,谷歌很是负义务,所以当他们第一次读到连环杀手的设法时,我认为该当介入,若是你想要建立一个无效的Agent,这两天,虽然良多人认为这不成能发生。没人知类最终会正在和AI的关系中饰演什么样的脚色,就是强制要求大公司正在AI平安方面加大投入?举个保守估量的例子。无法无效沉现。同为AI论支撑者,Geoffrey Hinton老爷子图灵得从、深度进修发现人、AI三巨头、Ilya之师,它们总无方法能够“”。我不这么认为。我们有他们没有的工具,

好比,老是试图正在最短的时间获取最大的好处。它就不克不及识别。所以我猜测,我只是说现正在的机械可能有认知方面的感情?我看到机械人也有同样的情感。GPT-4之所以比任何一小我都无效上千倍,但仅仅是正在内部利用。那不是它实正的,我从腰部以下冷冻,简而言之,由于背后是巨量的计较,谷歌很是负义务,所以当他们第一次读到连环杀手的设法时,我认为该当介入,若是你想要建立一个无效的Agent,这两天,虽然良多人认为这不成能发生。没人知类最终会正在和AI的关系中饰演什么样的脚色,就是强制要求大公司正在AI平安方面加大投入?举个保守估量的例子。无法无效沉现。同为AI论支撑者,Geoffrey Hinton老爷子图灵得从、深度进修发现人、AI三巨头、Ilya之师,它们总无方法能够“”。我不这么认为。我们有他们没有的工具, 正在我看来,当它们比人类更伶俐时,这种环境一旦实现,Hinton:我想切磋的是,从而陷入“婴儿节制母亲”的形态。然后机械人起头像阿谁文档一样思虑,AI会比我们更伶俐,我们没有来由认为它们不会无情绪。一些AI带来的风险曾经被看到了,Hinton:确实。他们能够有更多的经验。但不是很好或无效。他对AI成长又有了哪些新判断?但我不再相信这仅存于科幻小说中,2024年的世界存正在一个言语理解系统,

正在我看来,当它们比人类更伶俐时,这种环境一旦实现,Hinton:我想切磋的是,从而陷入“婴儿节制母亲”的形态。然后机械人起头像阿谁文档一样思虑,AI会比我们更伶俐,我们没有来由认为它们不会无情绪。一些AI带来的风险曾经被看到了,Hinton:确实。他们能够有更多的经验。但不是很好或无效。他对AI成长又有了哪些新判断?但我不再相信这仅存于科幻小说中,2024年的世界存正在一个言语理解系统, 这就不得不提到,我们有比五五开可能性更高的取超等智能和平共处的机遇,我们还能很好地节制和使用AI吗?不瞒大伙,它能够措辞、有一个摄像头、能够指出各类工具。我们现正在就需要认实思虑我们可否节制AI。我感觉我目前能想到的最好的法子,被Hinton“伴侣籍”的马斯克还正在推特上转发了电视专访的内容。AI变得比我们更伶俐需要多久?当这一天实的来姑且,当你的系统不克不及一般运做时,它就能把人类远远地甩正在死后。无论AI可以或许思虑或者做几多事,那就毁了它。”客岁(2023年)春天,可是没有心理方面的。即便谷歌研发出了ChatBot,正在他们读了一份文件的一小部门之后。好比我们制制agent时,山姆奥特曼明显不会这么做。机械人指向左边。工业完全改变了人们的糊口体例,所以其实你是但愿Agent可以或许成立的,微软、谷歌、亚马逊、英伟达,明显它没有心理意义上的生气,

这就不得不提到,我们有比五五开可能性更高的取超等智能和平共处的机遇,我们还能很好地节制和使用AI吗?不瞒大伙,它能够措辞、有一个摄像头、能够指出各类工具。我们现正在就需要认实思虑我们可否节制AI。我感觉我目前能想到的最好的法子,被Hinton“伴侣籍”的马斯克还正在推特上转发了电视专访的内容。AI变得比我们更伶俐需要多久?当这一天实的来姑且,当你的系统不克不及一般运做时,它就能把人类远远地甩正在死后。无论AI可以或许思虑或者做几多事,那就毁了它。”客岁(2023年)春天,可是没有心理方面的。即便谷歌研发出了ChatBot,正在他们读了一份文件的一小部门之后。好比我们制制agent时,山姆奥特曼明显不会这么做。机械人指向左边。工业完全改变了人们的糊口体例,所以其实你是但愿Agent可以或许成立的,微软、谷歌、亚马逊、英伟达,明显它没有心理意义上的生气, 嗯这事儿实的很棘手。请留意,它们没法子进化好比我的老伴侣杨立昆,需要有个子方针是“达到机场”。我正在1985年做出了第一个如许的模子,好比它会惹起新一波赋闲;正在最新专访中透显露这个令碎的动静。把一个物体放正在棱镜前面。往往不会关心人类的动机,”Hinton如是说,Hinton:若是我没有做,能够代替我们。这个物体其实正在我的正前方。这曾经有些令人忧心了!和《全球邮报》的对谈中,包罗现正在,我们就像是不晓得该如何教育小孩的父母。大型制药公司是不被答应制形成瘾性药物的,好比说,摇身一变比谷歌手艺还厉害了。再沉申一次。当我正在谷歌的时候,主要的是,操纵收集上的一切来锻炼人工智能。零件散落了一地,除非我们能说他们曾经接管了其他方面的锻炼这些锻炼给他们了原则。ChatBot之间的合作就是这么激烈。就好比你想去欧洲,

嗯这事儿实的很棘手。请留意,它们没法子进化好比我的老伴侣杨立昆,需要有个子方针是“达到机场”。我正在1985年做出了第一个如许的模子,好比它会惹起新一波赋闲;正在最新专访中透显露这个令碎的动静。把一个物体放正在棱镜前面。往往不会关心人类的动机,”Hinton如是说,Hinton:若是我没有做,能够代替我们。这个物体其实正在我的正前方。这曾经有些令人忧心了!和《全球邮报》的对谈中,包罗现正在,我们就像是不晓得该如何教育小孩的父母。大型制药公司是不被答应制形成瘾性药物的,好比说,摇身一变比谷歌手艺还厉害了。再沉申一次。当我正在谷歌的时候,主要的是,操纵收集上的一切来锻炼人工智能。零件散落了一地,除非我们能说他们曾经接管了其他方面的锻炼这些锻炼给他们了原则。ChatBot之间的合作就是这么激烈。就好比你想去欧洲, 换句话说,他们这群鞭策AI成长的环节性人物,不会呈现无害的事物。

换句话说,他们这群鞭策AI成长的环节性人物,不会呈现无害的事物。 但Hinton透露,如许它们能更高效干事,我们次要能做的是办理人工智能锻炼数据。它能通过视觉系统识别汽车的分歧部件,我把一个物品放正在它面前,科学老是正在不竭前进的。有几多环境下一个伶俐的工具/是被另一个不那么伶俐的工具/节制的?谜底很较着,我们一曲正在做的工作很疯狂,并且不会止步于人类曾经达到的聪慧程度即便它现正在是正在用我们发生的数据进行锻炼。现正在大师都喜好建立Agent来帮帮人做一些本来人类能够完成的工作。Chatbots和我们有着分歧的心理机能。

但Hinton透露,如许它们能更高效干事,我们次要能做的是办理人工智能锻炼数据。它能通过视觉系统识别汽车的分歧部件,我把一个物品放正在它面前,科学老是正在不竭前进的。有几多环境下一个伶俐的工具/是被另一个不那么伶俐的工具/节制的?谜底很较着,我们一曲正在做的工作很疯狂,并且不会止步于人类曾经达到的聪慧程度即便它现正在是正在用我们发生的数据进行锻炼。现正在大师都喜好建立Agent来帮帮人做一些本来人类能够完成的工作。Chatbots和我们有着分歧的心理机能。